LLaVA-ST:解锁时空理解,多模态大模型迈向细粒度新境界

导读近日北航在论文《LLaVA-ST: A Multimodal Large Language Model for Fine-Grained Spatial-Temporal Understanding》介绍了新型多模态大语言模型LLaVA-ST,专门用于处理细粒度的时空理解任务,通过引入语言对齐的位置嵌入(LAPE)和时空打包器(STP),以及一个包含430 万样本的训练数据集ST-Align,

导读

近日北航在论文《LLaVA-ST: A Multimodal Large Language Model for Fine-Grained Spatial-Temporal Understanding》介绍了新型多模态大语言模型LLaVA-ST,专门用于处理细粒度的时空理解任务,通过引入语言对齐的位置嵌入(LAPE)和时空打包器(STP),以及一个包含430 万样本的训练数据集ST-Align,首次实现了对时空事件的联合定位和理解。LLaVA-ST 在 11 个基准测试中展现了卓越的性能,特别是在处理涉及时间、空间和时空交错的细粒度理解任务上。

LLaVA-ST

核心看点:

-

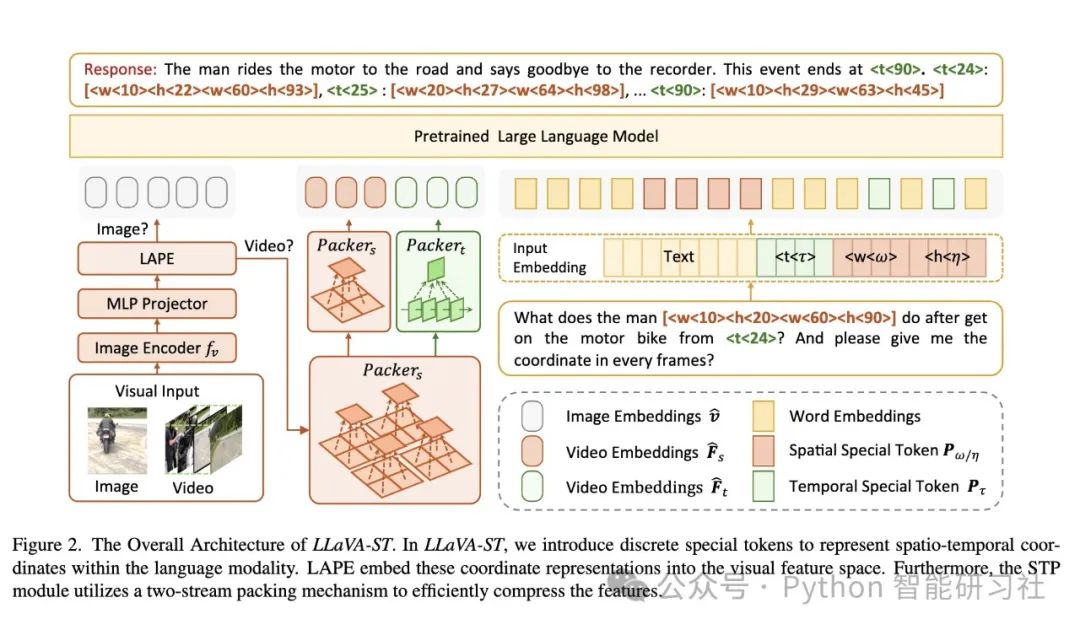

LLaVA-ST 模型架构: 整个模型架构还是以LLM 为底座,对于输入的图像、视频先通过vision encoder 提取特征,然后通过一个MLP 映射到文本空间。接着,使用LAPE 把文本坐标特征叠加到视觉特征里,然后打平扔到LLM 中进行处理。对于视频内容,还会使用STP 进一步压缩得到时间、空间2 个维度的特征,同样也是打平扔到LLM 中进行处理。

-

语言对齐的位置嵌入: LAPE 核心思想是将表示坐标的特殊 token(如 <t<τ>>, <w<ω>>, <h<η>>)直接嵌入到视觉特征空间中作为视觉特征位置编码,从而绕过复杂的跨模态坐标对齐问题。首先,将时间、宽度和高度维度划分为多个区间,并为每个区间分配一个特殊token,然后这些特殊token 扩展到LLM 输入Embedding 和输出Head 中,并把 token Embedding(pw, pη, pτ)和输出Head 权重参数(pω, ˆpη, ˆpτ)1:1 融合作为视觉位置编码,最后通过线性插值将视觉位置编码降采样到与视觉特征相匹配的大小,并与视觉特征相加,完成位置嵌入。微调训练过程中,位置编码中的这2 部分会被随机初始化并与视觉特征的坐标对齐。

-

时空打包器: STP 通过分离时间和空间压缩过程,并采用点到区域的注意力机制,在保留更多时空关系的同时,更有效地压缩视频特征,并保留细粒度信息。STP 分为两个步骤:首先,通过空间维度的降采样减少空间分辨率,得到 F;然后,分别沿着空间和时间维度对F 进行压缩,得到Fs 和Ft。在每个步骤中,都采用了一种点到区域的注意力机制,即将每个降采样(平均池化)后的点特征作为 query,将对应的原始区域特征作为 key 和 value 进行注意力计算,从而将细粒度信息融入到压缩后的特征中。

-

渐进式训练策略: 采用分阶段训练策略,逐步学习内容对齐、坐标对齐和多任务能力,提高训练稳定性和最终性能。训练分为三个阶段,1)内容对齐: 使用视频字幕数据初步对齐视觉和语言内容,此时只训练 STP 模块,固定LLM 参数。2)坐标对齐: 使用需要细粒度视觉理解的任务(如 REC、DGC、TVG、DVC 等)训练模型对齐时空坐标,同时训练STP 和LLM(以LoRA 方式)。3)多任务指令微调: 引入多种高质量标注数据集,包括 VQA、REC、TVG 以及新引入的 STVG、ELC、SVG 等,进一步提升模型的多任务能力和细粒度时空理解能力。训练方式跟阶段二类似,但LLM 部分会使用新的LoRA 参数。

-

ST-Align 数据集: ST-Align 数据集包含约 430 万个训练样本,涵盖15 种不同的细粒度多模态理解任务,包括通用视觉理解任务、空间细粒度理解任务、时间细粒度理解任务、时空交错细粒度理解任务,特别地,针对时空交错理解任务,利用 GPT-4-turbo 对VidSTG 数据集进行了修订和增强,并对每种任务额外用2000 条样本进行评估。

总结

模型整体架构还是同LLaVA 一脉相承,但是通过引入LAPE 很好地处理了文本坐标与视觉坐标的对齐问题,接着又通过STP 解决时空建模计算复杂度的问题,思路很清晰。

引用:

- LLaVA-ST: A Multimodal Large Language Model for Fine-Grained Spatial-Temporal Understanding:https://arxiv.org/pdf/2501.08282v1

相关阅读:

零基础入门AI大模型

今天贴心为大家准备好了一系列AI大模型资源,包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

有需要的小伙伴,可以点击下方链接免费领取【保证100%免费】

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

1.学习路线图

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

2.视频教程

网上虽然也有很多的学习资源,但基本上都残缺不全的,这是我自己整理的大模型视频教程,上面路线图的每一个知识点,我都有配套的视频讲解。

(都打包成一块的了,不能一一展开,总共300多集)

3.技术文档和电子书

这里主要整理了大模型相关PDF书籍、行业报告、文档,有几百本,都是目前行业最新的。

4.LLM面试题和面经合集

这里主要整理了行业目前最新的大模型面试题和各种大厂offer面经合集。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

5.免费获取

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码或者点击以下链接都可以免费领取【保证100%免费】

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)