文献阅读篇#8:YOLO如何实现多模态

文章提出Mul-YOLO多模态目标检测模型,通过融合水下声信号的时间序列和时频图像数据进行频谱感知。模型采用并行双骨干网络:改进的CSPDarknet处理小波变换图像,MobileNetV1变体处理时间序列数据,并引入模态交互模块和注意力机制进行特征融合。实验表明,在低信噪比条件下Mul-YOLO的检测率达95.3%,显著优于传统单模态方法。该研究为YOLO在多模态场景的扩展提供了新思路,但实时性

一、引言

YOLO众所周知是一个目标检测、跟踪、计数等等的视觉模型,对于YOLO来说,它的核心功能还是分类,识别出物体的类别并辅助以计数、跟踪等等功能。但是,光使用一个YOLO模型进行目标检测只能提取一张图片的特征,或者只能通过一条路去提取特征,最终输出结果。

而前面提到的多模态,则会引入另一个维度的特征。例如二区Top期刊《Underwater acoustic intelligent spectrum sensing with multimodal data fusion: An Mul-YOLO approach》

这篇文章提出了一种基于多模态数据融合的智能频谱感知方案。该系统获得了水声信号的时间序列数据,并利用小波变换获得了相应的图像数据,时间序列和图像数据构成了多模态数据,提供了更全面的时间和空间该分支首先对时间序列数据进行多模态特征提取,然后采用带去噪自编码器的无监督学习方法提取高质量的时间序列特征,最后构造了一个并行双骨干YOLO网络,弥补了传统YOLO网络无法提取多模态特征的不足,而另一个分支使用改进的CSPDarknet捕获关键空间特征。

我们以这篇文章为例,看看YOLO的多模态化改造是如何进行的!

二、文章解读

1、文章写作思路概述

1.1 研究背景与问题提出

文章从海洋物联网(OIoT)的现实需求出发,指出当前海洋通信中声频谱资源紧张,且传统频谱感知方法在海洋复杂环境下准确性不足,尤其在低信噪比(SNR)环境下性能下降明显。为此,作者提出通过多模态数据融合提升频谱感知能力。

1.2 技术创新点布局

文章构建了一个结合时间序列数据与频域图像数据的多模态数据库,并引入改进YOLO结构构建Mul-YOLO模型。整篇文章的逻辑清晰,分为如下几个部分:

-

引入背景及挑战

-

多模态数据构建方法

-

Mul-YOLO模型设计与结构

-

模型性能评估与对比实验

-

总结与未来展望

通过引入DAE降噪、双Backbone并行结构、模态交互机制与注意力机制等手段,文章系统性地展示了在海洋复杂声学环境中提高频谱感知准确性的方法。

2、多模态YOLO模型(Mul-YOLO)搭建方法

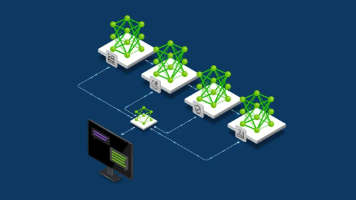

Mul-YOLO模型是本文提出的核心方案,整体架构如下图所示(对应原文Fig. 4):

2.1 数据预处理与多模态构建

-

时间序列数据(TDs):

-

从水下声学信号采集;

-

采用“降噪自编码器(DAE)”对其去噪处理,提取关键特征;

-

输入Backbone2网络进行处理。

-

-

图像数据(Ps):

-

利用**一维连续小波变换(CWT)**将时间序列转换为时频图谱;

-

得到二维图像形式;

-

输入Backbone1网络。

-

-

归一化处理:为解决特征量纲不一致问题,对所有数据使用最大最小归一化处理。

2.2 双Backbone架构设计

Mul-YOLO采用并行双Backbone结构,分别提取时域和频域的多层特征。

1.Backbone1(图像分支)

-

基于改进的CSPDarknet;

-

结构包含CBS(Conv+BN+SiLU)、C3模块与SPP模块;

-

用于提取频域图像的空间特征(feat1、feat2、feat3)。

2.Backbone2(时间序列分支)

-

采用MobileNetV1变体,更轻量化;

-

核心模块为CBR(Conv+BN+ReLU6)与DSC(深度可分离卷积);

-

用于提取时间序列的时域特征(feat4、feat5、feat6)三个层级的“伪图像特征图”;

-

降低计算复杂度同时保留特征多样性。

2.3 模态交互模块设计(Modal Interaction)

模态融合是Mul-YOLO的重要部分,分为以下几个步骤:

🔸 特征对齐融合

将对应层次的图像特征(feat13)与时间序列特征(feat46)做融合输入至交互网络。

🔸 空间注意力机制(CA Module)

引入Coordinate Attention模块:

-

利用水平/垂直全局池化提取位置信息;

-

聚焦目标空间位置及方向,提高关键特征表达能力。

🔸 多尺度特征增强

通过UpSample、C3、CBS等层提取并融合空间-时间多尺度信息,增强模型对复杂弱信号的识别能力。

🔸 最终分类输出

融合后的特征通过全连接层与Softmax函数进行二分类输出,判断频谱是否被占用。

说明:

这边给Backbone2(时间序列分支)的Input会发现是一串数字,那么专为图像设计的YOLO怎么处理数字呢?

文章改为使用 轻量化 MobileNetV1 架构,专门为时间序列定制;

包括:CBR 模块(Conv+BN+ReLU6)

DSC 模块(Depthwise Separable Convolution)等等

这些模块是为处理1×200×40尺寸的时序“类图像”数据准备的,也就是将一维序列升维为伪二维输入格式,方便CNN结构操作。

一同操作以后,再把时域特征(feat4、feat5、feat6)和空间特征(feat1、feat2、feat3)融合。由于图像信息本就由这串数据小波变换而来,因此相当于做了两遍检查,效果应当会更好,可解释性还是蛮强的。

3、实验设计与性能评估

3.1 模型训练设置

-

优化器:Adam;

-

学习率:1e-5;

-

批大小:32;

-

数据集划分:训练:验证:测试 = 8:1:1;

-

样本数:共3932条(1966时序+1966图像)。

3.2 对比结果(与CNN、ResNet、YOLOv5等模型)

| 模型 | 平均检测率 PdP_dPd | 平均误报率 PfP_fPf |

|---|---|---|

| Mul-YOLO | 95.3% | 3.1% |

| CNN | 86.0% | 15.8% |

| ResNet | 89.4% | 14.3% |

| YOLOv5 | 84.6% | 14.1% |

| ConvNeXt | 76.4% | 10.1% |

| Swin-Transformer | 84.4% | 14.6% |

说明:Mul-YOLO在低SNR条件下的检测率远超传统模型,尤其在-12dB下达80%。

4、结语与评价

4.1 总结评价

该文系统性地提出了一种基于多模态数据融合的水下频谱感知模型——Mul-YOLO。通过创新的数据处理方法与深度网络结构设计,有效解决了传统单模态频谱感知方法在低信噪比、复杂水下环境下准确率低的问题。

4.2 优点

-

架构设计科学合理,兼顾精度与计算复杂度;

-

实验验证充分,横向对比突出性能提升;

-

数据预处理与融合策略具有较强的推广性。

4.3 不足与展望

-

实时性与安全性评估尚待深入;

-

数据集规模较小,未来应结合更多实海数据提升泛化能力。

三、总结

通过对《Underwater acoustic intelligent spectrum sensing with multimodal data fusion: An Mul-YOLO approach》一文的深入解读,我们可以看到YOLO网络在多模态场景下的灵活扩展能力。该文不仅展示了YOLO从图像检测向时序数据感知的跨域迁移,还通过引入时间序列与图像数据的融合、双Backbone结构、注意力机制等设计,大幅提升了模型在复杂水下环境中的频谱感知准确率。Mul-YOLO的提出充分说明了“结构迁移 + 多模态融合”可以为原本局限于视觉任务的模型开辟更广阔的应用场景,也为深度学习在物联网、通信信号分析等领域提供了新的参考范式。未来,这种多模态、轻量化、可解释性强的感知方案有望在更多实时、动态的环境中发挥作用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)