Qwen2.5-Omni-7B实战指南:从安装到多模态应用

Qwen2.5-Omni-7B实战指南:从安装到多模态应用【免费下载链接】Qwen2.5-Omni-7B项目地址: https://ai.gitcode.com/hf_mirrors/Qwen/Qwen2.5-Omni-7B...

Qwen2.5-Omni-7B实战指南:从安装到多模态应用

【免费下载链接】Qwen2.5-Omni-7B

本文全面介绍了Qwen2.5-Omni-7B多模态大模型的实战应用指南,涵盖从环境配置、依赖安装到多模态应用开发的完整流程。文章详细讲解了硬件要求、系统准备、核心依赖安装步骤,以及Transformers库的深度集成与模型加载方法。同时深入探讨了多模态输入处理机制、对话模板设计原理,以及音频输出配置与语音类型选择等关键技术,为开发者提供了从基础到高级的完整实战指导。

环境配置与依赖安装步骤

Qwen2.5-Omni-7B作为一个端到端的多模态模型,其环境配置和依赖安装需要特别注意硬件要求、软件版本兼容性以及多模态处理能力的支持。本节将详细指导您完成从基础环境搭建到完整依赖安装的全过程。

硬件要求与系统准备

在开始安装之前,请确保您的系统满足以下最低硬件要求:

| 硬件组件 | 最低要求 | 推荐配置 |

|---|---|---|

| GPU内存 | 16GB VRAM | 24GB+ VRAM |

| 系统内存 | 32GB RAM | 64GB+ RAM |

| 存储空间 | 50GB可用空间 | 100GB+可用空间 |

| CUDA版本 | CUDA 11.8+ | CUDA 12.0+ |

| Python版本 | Python 3.8+ | Python 3.10+ |

核心依赖安装步骤

1. 创建Python虚拟环境

首先创建一个专用的虚拟环境来隔离依赖:

# 创建虚拟环境

python -m venv qwen-omni-env

# 激活虚拟环境

source qwen-omni-env/bin/activate # Linux/Mac

# 或者

qwen-omni-env\Scripts\activate # Windows

2. 安装PyTorch与CUDA支持

根据您的CUDA版本安装对应的PyTorch:

# CUDA 11.8

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

# CUDA 12.1

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu121

# CPU版本(仅用于测试,性能较差)

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cpu

3. 安装Transformers预览版

Qwen2.5-Omni需要特定版本的Transformers库:

# 卸载现有版本

pip uninstall transformers

# 安装Qwen2.5-Omni专用预览版

pip install git+https://github.com/huggingface/transformers@v4.51.3-Qwen2.5-Omni-preview

4. 安装加速库

pip install accelerate

5. 安装多模态工具包

# 完整安装(包含视频处理)

pip install qwen-omni-utils[decord] -U

# 如果无法安装decord(非Linux系统)

pip install qwen-omni-utils -U

可选优化组件安装

Flash Attention 2 加速

为了获得最佳性能,建议安装Flash Attention 2:

pip install -U flash-attn --no-build-isolation

注意:Flash Attention 2需要兼容的硬件支持,请参考官方文档确认您的GPU是否支持。

音频处理依赖

# 音频编解码支持

pip install soundfile librosa

环境验证与测试

安装完成后,使用以下代码验证环境配置:

import torch

from transformers import Qwen2_5OmniForConditionalGeneration, Qwen2_5OmniProcessor

# 检查CUDA可用性

print(f"CUDA available: {torch.cuda.is_available()}")

print(f"GPU count: {torch.cuda.device_count()}")

if torch.cuda.is_available():

print(f"Current GPU: {torch.cuda.get_device_name(0)}")

print(f"GPU memory: {torch.cuda.get_device_properties(0).total_memory / 1024**3:.1f} GB")

# 检查关键库版本

import transformers

print(f"Transformers version: {transformers.__version__}")

常见问题解决

版本冲突处理

如果遇到版本冲突,建议使用以下命令清理并重新安装:

# 清理冲突包

pip uninstall transformers torch torchvision torchaudio

pip cache purge

# 重新安装指定版本

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

pip install git+https://github.com/huggingface/transformers@v4.51.3-Qwen2.5-Omni-preview

pip install accelerate qwen-omni-utils[decord]

内存不足处理

如果GPU内存不足,可以尝试以下优化:

# 使用内存优化配置

model = Qwen2_5OmniForConditionalGeneration.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

torch_dtype="auto",

device_map="auto",

attn_implementation="flash_attention_2" # 使用Flash Attention

)

环境配置检查清单

使用以下表格确保所有组件正确安装:

| 组件 | 要求版本 | 检查命令 | 预期输出 |

|---|---|---|---|

| Python | 3.8+ | python --version |

Python 3.8.0+ |

| PyTorch | 2.0+ | python -c "import torch; print(torch.__version__)" |

2.0.0+ |

| Transformers | 4.51.3 | python -c "import transformers; print(transformers.__version__)" |

4.51.3 |

| CUDA | 11.8+ | python -c "import torch; print(torch.version.cuda)" |

11.8+ |

| qwen-omni-utils | 最新 | python -c "import qwen_omni_utils; print('OK')" |

OK |

通过以上步骤,您已经成功完成了Qwen2.5-Omni-7B的环境配置和依赖安装。现在可以开始加载模型并进行多模态应用开发了。

Transformers库集成与模型加载

Qwen2.5-Omni-7B作为一款端到端多模态大模型,与HuggingFace Transformers库的深度集成为开发者提供了便捷的模型加载和使用体验。本节将详细介绍如何通过Transformers库加载和使用Qwen2.5-Omni-7B模型,包括环境配置、模型初始化、多模态处理等关键技术细节。

环境准备与依赖安装

在使用Qwen2.5-Omni-7B之前,需要确保正确安装相关依赖包。推荐使用Python 3.8+版本,并安装以下核心依赖:

pip install transformers>=4.40.0

pip install torch>=2.0.0

pip install accelerate

pip install sentencepiece

pip install librosa # 音频处理支持

pip install Pillow # 图像处理支持

pip install opencv-python # 视频处理支持

模型架构与配置文件解析

Qwen2.5-Omni-7B采用创新的Thinker-Talker架构设计,通过配置文件定义了完整的模型结构:

模型加载的三种方式

方式一:从HuggingFace Hub直接加载

from transformers import AutoModelForCausalLM, AutoTokenizer, AutoProcessor

import torch

# 加载模型、分词器和处理器

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

torch_dtype=torch.bfloat16,

device_map="auto",

trust_remote_code=True

)

tokenizer = AutoTokenizer.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

trust_remote_code=True

)

processor = AutoProcessor.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

trust_remote_code=True

)

方式二:从本地路径加载

如果已经下载了模型文件到本地目录,可以直接从本地加载:

model = AutoModelForCausalLM.from_pretrained(

"/path/to/Qwen2.5-Omni-7B",

torch_dtype=torch.bfloat16,

device_map="auto",

trust_remote_code=True

)

方式三:分组件加载

对于需要精细控制的场景,可以分别加载不同的组件:

from transformers import Qwen2_5OmniModel, Qwen2Tokenizer, Qwen2_5OmniProcessor

model = Qwen2_5OmniModel.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

torch_dtype=torch.bfloat16

)

tokenizer = Qwen2Tokenizer.from_pretrained(

"Qwen/Qwen2.5-Omni-7B"

)

processor = Qwen2_5OmniProcessor.from_pretrained(

"Qwen/Qwen2.5-Omni-7B"

)

特殊令牌与多模态标记

Qwen2.5-Omni-7B定义了丰富的特殊令牌来处理多模态输入输出:

| 令牌类型 | 令牌ID | 描述 | 用途 |

|---|---|---|---|

| 文本开始 | 151644 | <|im_start|> |

对话开始标记 |

| 文本结束 | 151645 | <|im_end|> |

对话结束标记 |

| 音频令牌 | 151646 | <|AUDIO|> |

音频输入标记 |

| 音频开始 | 151647 | <|audio_bos|> |

音频序列开始 |

| 音频结束 | 151648 | <|audio_eos|> |

音频序列结束 |

| 图像令牌 | 151655 | <|IMAGE|> |

图像输入标记 |

| 视频令牌 | 151656 | <|VIDEO|> |

视频输入标记 |

| 视觉开始 | 151652 | <|vision_bos|> |

视觉序列开始 |

| 视觉结束 | 151653 | <|vision_eos|> |

视觉序列结束 |

多模态数据处理流程

内存优化与设备映射

对于大模型加载,合理的内存管理至关重要:

# 使用设备映射优化GPU内存使用

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

torch_dtype=torch.bfloat16,

device_map="auto",

low_cpu_mem_usage=True,

offload_folder="./offload",

trust_remote_code=True

)

# 或者手动指定设备映射

device_map = {

"model.embed_tokens": 0,

"model.layers.0": 0,

"model.layers.1": 0,

# ... 更多层分配

"lm_head": 0

}

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

torch_dtype=torch.bfloat16,

device_map=device_map,

trust_remote_code=True

)

模型配置参数详解

Qwen2.5-Omni-7B的关键配置参数包括:

# 查看模型配置

print(f"模型类型: {model.config.model_type}")

print(f"隐藏层大小: {model.config.hidden_size}")

print(f"注意力头数: {model.config.num_attention_heads}")

print(f"层数: {model.config.num_hidden_layers}")

print(f"词汇表大小: {model.config.vocab_size}")

print(f"最大位置编码: {model.config.max_position_embeddings}")

# 多模态特定配置

print(f"音频支持: {model.config.enable_audio_output}")

print(f"Talker模块: {model.config.enable_talker}")

常见问题与解决方案

内存不足问题

# 解决方案1: 使用4位量化

from transformers import BitsAndBytesConfig

quantization_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_compute_dtype=torch.bfloat16,

bnb_4bit_use_double_quant=True,

)

model = AutoModelForCausalLM.from_pretrained(

"Qwen/Qwen2.5-Omni-7B",

quantization_config=quantization_config,

device_map="auto",

trust_remote_code=True

)

# 解决方案2: 使用梯度检查点

model.gradient_checkpointing_enable()

令牌化器特殊处理

# 处理多模态令牌

def prepare_multimodal_input(text, images=None, audio=None):

messages = [

{"role": "user", "content": text}

]

if images:

for img in images:

messages.append({"role": "user", "content": {"type": "image", "image": img}})

if audio:

messages.append({"role": "user", "content": {"type": "audio", "audio": audio}})

# 使用处理器准备输入

inputs = processor(

messages,

return_tensors="pt",

padding=True

)

return inputs

性能优化建议

- 使用BF16精度: 在支持BF16的硬件上使用

torch_dtype=torch.bfloat16 - 启用Flash Attention: 如果可用,启用Flash Attention加速推理

- 批处理优化: 合理设置批处理大小,平衡内存使用和吞吐量

- 缓存利用: 充分利用模型的KV缓存机制减少重复计算

通过上述详细的Transformers库集成与模型加载指南,开发者可以高效地在自己的项目中集成Qwen2.5-Omni-7B模型,充分利用其强大的多模态能力。正确的模型加载和配置是确保模型性能最大化的关键第一步。

多模态输入处理与对话模板

Qwen2.5-Omni-7B作为一款端到端的多模态大模型,其核心优势在于能够同时处理文本、图像、音频和视频等多种模态的输入,并生成相应的文本和语音响应。本节将深入探讨其多模态输入处理机制和对话模板的设计原理。

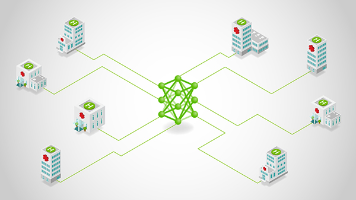

多模态输入处理架构

Qwen2.5-Omni采用了创新的Thinker-Talker架构,该架构专门设计用于处理多模态输入并生成多模态输出。整个处理流程可以分为以下几个关键阶段:

特殊令牌系统

Qwen2.5-Omni使用了一套精心设计的特殊令牌系统来处理多模态内容,这些令牌在tokenizer配置中定义:

| 令牌类型 | 令牌标识 | 功能描述 |

|---|---|---|

| 文本边界 | <|im_start|>, <|im_end|> |

标记对话开始和结束 |

| 图像标识 | <|IMAGE|> |

标识图像输入位置 |

| 音频标识 | <|AUDIO|> |

标识音频输入位置 |

| 视频标识 | <|VIDEO|> |

标识视频输入位置 |

| 视觉边界 | <|vision_bos|>, <|vision_eos|> |

视觉内容边界标记 |

| 音频边界 | <|audio_bos|>, <|audio_eos|> |

音频内容边界标记 |

对话模板机制

Qwen2.5-Omni的对话模板采用Jinja2模板引擎语法,支持动态的多模态内容处理。模板的核心逻辑包括:

# 简化的对话模板处理逻辑

def process_multimodal_conversation(messages):

audio_count = 0

image_count = 0

video_count = 0

for message in messages:

if message["role"] == "user":

# 处理用户输入中的多模态内容

if "image" in message["content"]:

image_count += 1

content = f"<|IMAGE|>{image_count}</|IMAGE|> {message['content']}"

elif "audio" in message["content"]:

audio_count += 1

content = f"<|AUDIO|>{audio_count}</|AUDIO|> {message['content']}"

elif "video" in message["content"]:

video_count += 1

content = f"<|VIDEO|>{video_count}</|VIDEO|> {message['content']}"

else:

content = message["content"]

formatted_message = f"<|im_start|>user\n{content}<|im_end|>"

elif message["role"] == "assistant":

formatted_message = f"<|im_start|>assistant\n{message['content']}<|im_end|>"

return formatted_message

多模态输入格式示例

在实际使用中,多模态输入需要按照特定的格式进行组织:

文本+图像输入示例:

messages = [

{

"role": "user",

"content": [

{"type": "text", "text": "请描述这张图片中的场景"},

{"type": "image", "image": "path/to/image.jpg"}

]

}

]

音频输入示例:

messages = [

{

"role": "user",

"content": [

{"type": "audio", "audio": "path/to/audio.wav"}

]

}

]

混合模态输入示例:

messages = [

{

"role": "user",

"content": [

{"type": "text", "text": "请分析这段音频和图片的关系"},

{"type": "audio", "audio": "path/to/audio.wav"},

{"type": "image", "image": "path/to/image.jpg"}

]

}

]

预处理配置详解

Qwen2.5-Omni的预处理配置定义了各模态的处理参数:

| 模态类型 | 配置参数 | 默认值 | 说明 |

|---|---|---|---|

| 图像处理 | image_mean | [0.481, 0.457, 0.408] | 图像归一化均值 |

| 图像处理 | image_std | [0.268, 0.261, 0.275] | 图像归一化标准差 |

| 图像处理 | max_pixels | 12845056 | 最大像素数量 |

| 音频处理 | sampling_rate | 16000 | 音频采样率 |

| 音频处理 | n_fft | 400 | FFT窗口大小 |

| 音频处理 | hop_length | 160 | 跳跃长度 |

| 视频处理 | nb_max_frames | 30000 | 最大帧数 |

| 视频处理 | temporal_patch_size | 2 | 时间补丁大小 |

实时流式处理

Qwen2.5-Omni支持实时流式处理,这对于语音对话和视频分析场景至关重要:

错误处理与边界情况

在多模态处理过程中,系统需要处理各种边界情况:

- 缺失模态处理:当某个模态数据缺失时,系统能够优雅降级

- 质量不佳的输入:对低质量图像或嘈杂音频的鲁棒性处理

- 模态冲突检测:识别和处理相互矛盾的模态信息

- 超长输入截断:智能截断超过模型限制的长内容

性能优化策略

Qwen2.5-Omni采用了多种性能优化策略:

- 并行处理:不同模态的编码器可以并行处理

- 内存优化:动态内存分配和释放机制

- 计算优化:针对各模态的专用计算优化

- 缓存机制:重复内容的智能缓存和重用

通过这种精心设计的多模态输入处理机制和对话模板系统,Qwen2.5-Omni-7B能够高效地处理复杂的多模态交互场景,为用户提供自然流畅的多模态对话体验。

音频输出配置与语音类型选择

Qwen2.5-Omni-7B作为一款端到端的多模态模型,其音频输出功能提供了强大的语音生成能力。本节将深入探讨音频输出的配置参数、语音类型选择机制以及最佳实践。

音频输出架构概览

Qwen2.5-Omni采用Thinker-Talker架构,其中Talker模块专门负责音频生成。音频生成流程遵循以下序列:

核心配置参数详解

1. 音频输出启用配置

在模型配置中,音频输出功能通过以下关键参数控制:

{

"enable_audio_output": true,

"enable_talker": true,

"sampling_rate": 16000,

"n_samples": 4800000

}

参数说明:

enable_audio_output: 全局音频输出开关enable_talker: Talker模块启用状态sampling_rate: 音频采样率(16kHz)n_samples: 最大采样点数

2. 音频token系统

模型使用专门的音频token来处理语音生成:

| Token类型 | Token ID | 功能描述 |

|---|---|---|

<|AUDIO|> |

151646 | 音频标记起始 |

<|audio_bos|> |

151647 | 音频开始标记 |

<|audio_eos|> |

151648 | 音频结束标记 |

| TTS Codec Start | 8293 | TTS编码开始 |

| TTS Codec End | 8294 | TTS编码结束 |

语音类型选择机制

1. 内置语音风格

Qwen2.5-Omni支持多种语音风格,通过不同的提示词进行选择:

# 不同语音风格的提示词示例

voice_styles = {

"neutral": "请用中性语气说:",

"friendly": "请用友好语气说:",

"professional": "请用专业语气说:",

"excited": "请用兴奋语气说:",

"calm": "请用平静语气说:"

}

# 使用示例

prompt = "请用友好语气说:欢迎使用Qwen2.5-Omni语音系统"

2. 多语言支持配置

模型支持多种语言的语音生成,语言切换通过语言标识符实现:

language_codes = {

"中文": "zh",

"英文": "en",

"日语": "ja",

"法语": "fr",

"德语": "de",

"西班牙语": "es"

}

# 多语言语音生成示例

multilingual_prompt = """

<|im_start|>system

你是一个多语言语音助手,请用{language}说出以下内容:

{text}

<|im_end|>

"""

音频质量调优参数

1. 音频编码配置

{

"tts_codec_config": {

"vocab_size": 8448,

"hidden_size": 896,

"num_hidden_layers": 24,

"num_attention_heads": 12,

"intermediate_size": 18944

}

}

2. 实时流式输出配置

对于实时语音聊天场景,模型支持流式输出配置:

streaming_config = {

"chunk_length": 300, # 每块音频长度

"hop_length": 160, # 跳跃长度

"seconds_per_chunk": 2, # 每块时长(秒)

"position_id_per_seconds": 25 # 每秒位置ID数

}

高级音频控制功能

1. 情感语调控制

通过情感标签控制生成的语音情感:

emotion_controls = {

"happy": {"pitch_variation": 1.2, "speaking_rate": 1.1},

"sad": {"pitch_variation": 0.8, "speaking_rate": 0.9},

"angry": {"pitch_variation": 1.5, "speaking_rate": 1.3},

"calm": {"pitch_variation": 1.0, "speaking_rate": 1.0}

}

# 情感控制提示词模板

emotion_template = "请用{emotion}的情感说出:{text}"

2. 音色特征调整

模型支持对生成语音的音色特征进行微调:

| 参数 | 取值范围 | 效果描述 |

|---|---|---|

| pitch_variation | 0.5-2.0 | 音高变化程度 |

| speaking_rate | 0.5-2.0 | 语速调整 |

| energy_level | 0.5-2.0 | 能量级别 |

| voice_quality | 0.8-1.2 | 音质平滑度 |

性能优化建议

1. 内存使用优化

# 音频生成内存优化配置

memory_optimized_config = {

"max_audio_length": 30, # 最大音频时长(秒)

"chunk_overlap": 0.5, # 块重叠比例

"cache_audio_embeddings": True # 缓存音频嵌入

}

2. 延迟优化策略

故障排除与调试

常见问题解决

-

音频输出静音

- 检查

enable_audio_output配置 - 验证音频设备权限

- 检查

-

语音质量不佳

- 调整采样率配置

- 检查音频预处理参数

-

多语言支持问题

- 确认语言标识符正确性

- 检查tokenizer多语言支持

调试工具使用

# 音频调试信息输出

debug_config = {

"log_audio_tokens": True,

"log_tts_process": True,

"audio_quality_metrics": True

}

通过合理的配置和参数调优,Qwen2.5-Omni-7B能够生成高质量、自然流畅的语音输出,满足各种应用场景的需求。

总结

Qwen2.5-Omni-7B作为一款先进的端到端多模态大模型,通过创新的Thinker-Talker架构实现了文本、图像、音频和视频的高效处理与生成。本文从环境配置到多模态应用开发,系统性地介绍了模型的核心功能和使用方法。通过合理的硬件配置、依赖安装和参数调优,开发者可以充分利用模型的强大能力,构建自然流畅的多模态交互应用。正确的模型加载、多模态数据处理和音频输出配置是确保最佳性能的关键,本文提供的实战指南为各类应用场景提供了可靠的技术支持。

【免费下载链接】Qwen2.5-Omni-7B

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)