掌握Glove词向量模型:人工智能项目实践

htmltable {th, td {th {pre {简介:在自然语言处理中,将单词转化为包含其语义和语法特性的低维度连续向量至关重要。Glove模型通过捕获词汇间的共现统计信息来实现这一点,提供全局信息处理,并在大型语料库上有优异表现。本文深入探讨Glove模型的原理与应用,阐述如何使用预训练模型和自训练模型,以及Glove如何在语义相似性和下游NLP任务性能提升中发挥作用。

简介:在自然语言处理中,将单词转化为包含其语义和语法特性的低维度连续向量至关重要。Glove模型通过捕获词汇间的共现统计信息来实现这一点,提供全局信息处理,并在大型语料库上有优异表现。本文深入探讨Glove模型的原理与应用,阐述如何使用预训练模型和自训练模型,以及Glove如何在语义相似性和下游NLP任务性能提升中发挥作用。

1. 词向量表示的重要性

随着自然语言处理(NLP)技术的飞速发展,词向量表示已成为该领域的核心技术之一。词向量,简单来说,是将词语转化为计算机能够理解的数值形式,以实现机器学习和深度学习中的有效处理。它们是连接自然语言和算法逻辑的桥梁,对于提升机器翻译、文本分类、情感分析等NLP任务的性能至关重要。

词向量的引入不仅极大地提高了机器学习模型处理文本的能力,还催生了如Word2Vec、GloVe等多种优秀的词向量生成模型,其中GloVe模型的提出,标志着词向量从局部语境到全局语料库的有效转变。

在后续的章节中,我们将详细介绍GloVe模型的理论基础、工作原理、优化策略以及在实际NLP任务中的应用,深入探讨如何通过该模型生成高质量的词向量,并最终实现对语言的深度理解。

2. Glove模型的全局向量表示

2.1 Glove模型的理论基础

2.1.1 词向量表示的历史演变

词向量表示的历史演变,可以从最初的one-hot编码开始说起。这种编码方式是将词汇表中的每个单词表示为一个长度为词汇表大小的向量,其中每个元素都是0,除了该单词对应的索引位置是1。这种表示方法虽然简单明了,但是它存在严重的缺陷:无法表示单词之间的语义关系,且由于向量空间巨大而十分稀疏。

随后,词袋模型(Bag of Words, BoW)和词频-逆文档频率模型(Term Frequency-Inverse Document Frequency, TF-IDF)出现,它们利用统计信息来表示文本,将文本转化为一系列数值,用于文本分析和处理。但这些方法仍然缺乏捕捉语义的能力。

紧接着,神经网络语言模型和词嵌入技术应运而生。神经网络语言模型通过深层网络结构对文本进行建模,可以捕捉单词之间的依赖关系。而词嵌入技术,如Word2Vec和GloVe模型,则能够将每个单词映射到一个稠密的向量空间中,使得语义上相近的单词在向量空间中也接近。

2.1.2 全局向量表示(Glove)的提出

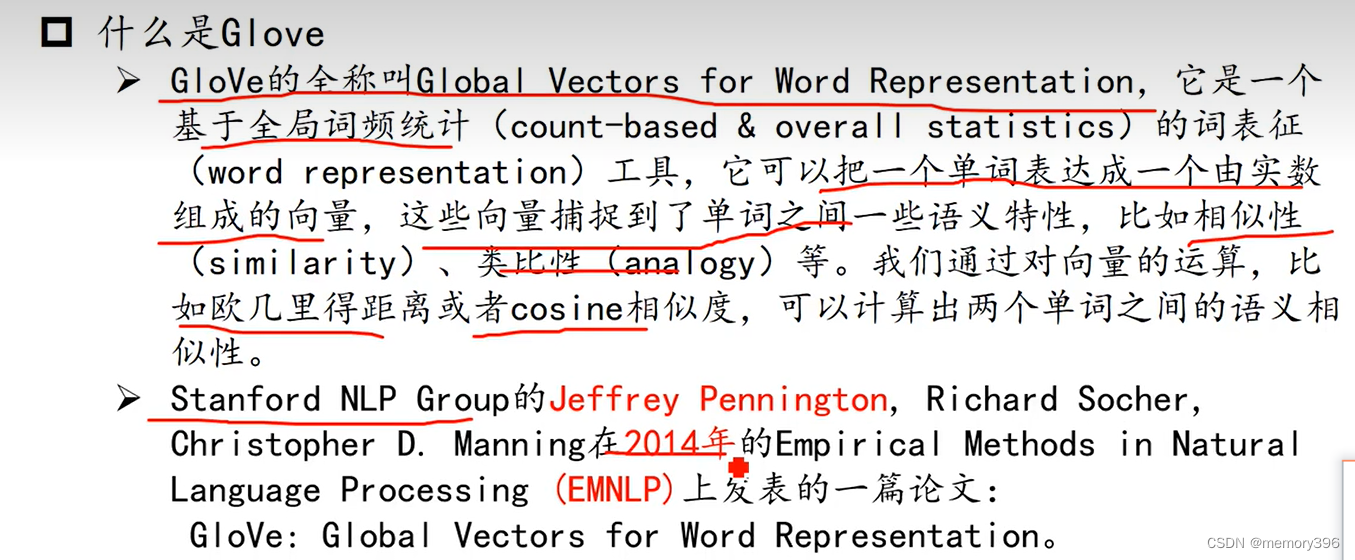

GloVe模型(Global Vectors for Word Representation)是全局词向量的一种,其核心思想是通过全局的词频统计信息来学习单词的向量表示。与局部词向量模型(例如Word2Vec)不同,GloVe模型不仅仅考虑了单词的局部上下文信息,而是利用了全局的词汇共现信息。

GloVe模型的提出,解决了传统词嵌入模型的一些问题,例如在处理大型语料库时计算成本高和容易出现过拟合等问题。该模型利用了整个语料库的信息,并且通过矩阵分解技术来提高训练效率。

GloVe模型的设计兼顾了效率和效果,它结合了局部上下文窗口(如Word2Vec)和全局语料统计信息,因此GloVe模型能够在较低维度的向量空间中有效地捕捉词汇间的共现信息和语义关系。

2.2 Glove模型的关键特性

2.2.1 模型的数学表达和结构

GloVe模型基于一个全局词-词共现矩阵(X)构建,其中(X_{ij})表示单词(i)和(j)在某个窗口内共同出现的次数。模型假设两个单词的共现概率的比值能够揭示它们之间的语义关系。

GloVe模型通过最小化以下目标函数来训练:

[

J(\theta) = \sum_{i,j=1}^{V} f(X_{ij}) \left( w_i^T \tilde{w} j + b_i + \tilde{b}_j - \log(X {ij}) \right)^2

]

其中,(w_i)和(\tilde{w}_j)分别是单词(i)和(j)的向量表示,(b_i)和(\tilde{b}_j)是它们的偏置项,(f)是一个权重函数,用来确保频繁出现的单词共现对模型训练的贡献不会过大。(V)表示词汇表的大小。

2.2.2 全局矩阵分解的优化目标

GloVe模型的优化目标是通过最小化损失函数来学习全局矩阵分解。在此过程中,每个单词的向量表示和偏置项是从整个语料库的共现统计信息中学习得到的。这与传统的矩阵分解方法不同,后者通常用于处理推荐系统中的用户-项目交互矩阵。

通过全局矩阵分解,GloVe模型能够捕捉到单词之间的共现模式,从而使得在向量空间中,语义相近的单词在向量空间中也相近。这一特性使GloVe模型在很多自然语言处理任务中表现优异。

2.2.3 代码实现和逻辑分析

下面是一个简单的GloVe模型的Python代码示例,使用了Gensim库来训练词向量:

import gensim

from gensim.models import GloVe

# 假设已经有一个预处理好的语料库

corpus = [list_of_tokenized_sentences]

# 设置GloVe模型的参数

size = 100 # 输出向量的维度

window = 5 # 上下文窗口大小

min_count = 5 # 单词的最小出现次数

x_max = 100 # 限制词频最大的指数权重

# 训练GloVe模型

glove = GloVe(size=size, window=window, min_count=min_count, x_max=x_max)

glove.build_vocab(corpus)

glove.train(corpus, total_examples=glove.corpus_count, epochs=100)

# 输出某个单词的向量

print(glove['example_word'])

在这段代码中, Gensim 库的 GloVe 类被用来构建和训练模型。首先,我们初始化一个GloVe模型实例,设置输出向量的维度、上下文窗口大小、单词的最小出现次数和词频的最大指数权重。之后,使用 build_vocab 方法来建立词汇表, train 方法用来训练模型。最后,可以直接通过索引的方式输出特定单词的向量。

通过执行上述代码块,我们将得到每个单词的词向量表示,这些向量可以在下游的NLP任务中进行使用,如文本分类、情感分析等。通过调整模型参数,我们可以优化模型以适应具体的应用场景。

3. 理解Glove的工作原理

随着自然语言处理(NLP)的发展,词向量表示技术不断进步,Glove模型作为其中的佼佼者,通过学习大规模的单词共现数据,捕捉到了丰富的单词语义信息,对后续的语义理解和应用有着重要的影响。理解Glove的工作原理,需要深入探讨其训练流程和权重解析机制。

3.1 Glove模型的训练流程

Glove模型的训练流程是通过大量文本数据中的单词共现信息来训练词向量,这一步骤的关键是共现矩阵的构建和损失函数的设计。

3.1.1 数据预处理和单词共现矩阵

在Glove模型中,单词共现矩阵是词向量学习的重要数据来源,反映了单词之间的共现关系。首先,对大规模文本数据进行预处理,提取单词,并构建单词共现矩阵X。矩阵的每一行代表一个单词,每一列代表一个上下文窗口,矩阵中的元素X_ij表示单词i在单词j的上下文窗口中出现的次数。

# 示例:构建共现矩阵的伪代码

import numpy as np

def build_co_occurrence_matrix(corpus, window_size):

vocabulary_size = len(set(corpus))

co_occurrence_matrix = np.zeros((vocabulary_size, vocabulary_size), dtype=int)

for i in range(len(corpus)):

# 确定上下文窗口内的单词索引

window_indices = [i - window_size, i + window_size]

window_tokens = [corpus[j] for j in range(len(corpus)) if j in window_indices]

word_i_index = vocabulary.index(corpus[i])

for word_j in window_tokens:

word_j_index = vocabulary.index(word_j)

co_occurrence_matrix[word_i_index][word_j_index] += 1

return co_occurrence_matrix

# 假设已经完成corpus分词和vocabulary单词列表建立

corpus = ["the", "cat", "sat", "on", "the", "mat"]

window_size = 2

co_occurrence_matrix = build_co_occurrence_matrix(corpus, window_size)

3.1.2 损失函数的设计和优化算法

Glove模型使用对数共现概率作为损失函数,通过最小化损失函数来训练模型。设计损失函数时,Glove模型考虑到了单词共现概率和单词向量的内积的关系,损失函数的定义如下:

L = Σ_i Σ_j (w_ij * (x_ij - x’^_ij)^2)

其中,x_ij是单词i和j的共现概率,x’^_ij是它们单词向量的内积,w_ij是权重函数,通常用来降低不频繁共现单词对损失函数的影响。

# 示例:损失函数的伪代码

import tensorflow as tf

def glove_loss(X, X_hat, weights):

return tf.reduce_sum(weights * tf.square(X - X_hat))

# 假设X是共现矩阵,X_hat是预测的共现概率内积矩阵

weights = ... # 权重矩阵,可能基于共现频次来确定

glove_loss_value = glove_loss(X, X_hat, weights)

优化算法通常使用梯度下降法,例如随机梯度下降(SGD),在大规模数据集上不断迭代,以优化损失函数。

3.2 Glove模型的权重解析

理解Glove模型权重解析的过程是深入掌握Glove工作原理的关键,其中共现概率的计算和单词向量的数学解读是核心。

3.2.1 共现概率的计算方法

共现概率的计算是Glove模型权重解析中的一个关键步骤,模型通过对共现矩阵中的值进行归一化处理,得到了单词共现的概率。

# 共现概率计算示例代码

def compute_co_occurrence_probabilities(co_occurrence_matrix):

probabilities = co_occurrence_matrix.astype(np.float32) / np.sum(co_occurrence_matrix, axis=1, keepdims=True)

return probabilities

co_occurrence_probabilities = compute_co_occurrence_probabilities(co_occurrence_matrix)

在实践中,我们通常对概率值进行对数变换以稳定数值,对非常小的概率值进行平滑处理。

3.2.2 单词向量的数学解读

Glove模型中的单词向量是在内积空间中的表示,内积接近的向量表示语义上接近的单词。单词向量的维度一般远小于语料库的大小,它们是通过对共现矩阵中单词对的共现概率进行学习得到的。

# 单词向量计算示例代码

def train_glove(X, vocabulary, dim=100, max_iter=100):

# 初始化单词向量和上下文向量

word_vectors = np.random.randn(len(vocabulary), dim)

context_vectors = np.random.randn(len(vocabulary), dim)

for epoch in range(max_iter):

for i in range(X.shape[0]):

for j in range(X.shape[1]):

if X[i][j] > 0:

f = np.concatenate((word_vectors[i], context_vectors[j]))

grad = gradient_descent_step(f, X[i][j])

word_vectors[i] -= grad[:word_vectors.shape[1]]

context_vectors[j] -= grad[word_vectors.shape[1]:]

return word_vectors, context_vectors

def gradient_descent_step(f, y):

# 此处为梯度下降法的一个简化实现,具体梯度计算依据Glove损失函数

alpha = 0.01

grad = 2 * (f - np.log(y)) * f

return -alpha * grad

word_vectors, context_vectors = train_glove(co_occurrence_matrix, vocabulary)

最终,通过交替迭代单词向量和上下文向量,可以使它们都逼近最优的表示。

在本章节中,我们从Glove模型的训练流程谈起,细致解析了数据预处理、共现矩阵的构建以及损失函数的设计,通过实际的代码示例,加深了对训练步骤的理解。随后,我们转而分析了权重解析,特别是共现概率的计算方法和单词向量的数学解读,通过示例代码深入探讨了其背后的数学原理。这些内容为理解Glove模型的工作原理奠定了坚实的基础,为进一步在自然语言处理任务中应用Glove模型提供了有力支撑。在后续的章节中,我们将更深入地探讨Glove模型在NLP任务中的应用以及如何优化其性能。

4. Glove模型的语义相似性分析

4.1 词向量的语义特性

4.1.1 词义关系的几何解释

在高维空间中,词向量之间的几何关系可以解释为词义之间的关联性。通过词向量模型,如Glove,可以将词语嵌入到一个连续的向量空间中,其中每个向量对应一个词语。词向量的几何性质表明,词与词之间的语义关系可以通过向量之间的几何距离和角度来衡量。

例如,我们可以观察到在高维空间中,向量的加减运算能够体现某些词义的规则性。如“king” - “man” + “woman” 的结果向量距离“queen”较近。这些运算揭示了词向量表示的内在结构和语义规则性,这也是Glove模型的核心优势之一。

4.1.2 语义相似性与距离度量

语义相似性可以通过衡量词向量之间的距离来进行量化。Glove模型中,最常用的距离度量方式是余弦相似性,它衡量了两个向量的夹角大小,该值越大表示两个词向量越相似。具体地,对于两个词向量x和y,它们的余弦相似性可以由公式计算得到:

similarity(x, y) = cos(x, y) = \frac{x \cdot y}{||x|| \cdot ||y||}

其中, x⋅y 表示向量x和y的点积, ||x|| 和 ||y|| 分别表示向量x和y的范数。

使用余弦相似性度量词向量之间的语义关联,能够在一定程度上区分同义词和反义词等语义关系。当两个词向量的余弦相似性高时,我们可以认为这两个词在语义上是相近的。

4.2 实证分析:Glove与其它模型的比较

4.2.1 Glove与其他词向量模型的对比

Glove模型在与其它流行的词向量模型,如Word2Vec和FastText进行对比时,具有独特的优缺点。首先,Glove模型结合了全局矩阵分解的优势,能够捕捉到更为丰富的词共现信息,并且在一些任务中它比Word2Vec表现更为优异,尤其是在处理具有丰富语境信息的任务时。

然而,Glove模型同样存在局限性。它在处理罕见词和处理语境变化上不如FastText灵活。FastText通过子词单元来表示词,可以捕捉到词缀信息,同时对词根、词缀和词的组合性信息有更好的处理能力。这一点对于多语言和形态丰富的语言尤其重要。

4.2.2 实验结果分析和讨论

在实际的NLP任务中,如情感分析、文本分类等,Glove模型通常能够提供与任务高度相关的词向量。然而,为了得到最优的性能,往往需要进行细致的参数调整和模型微调。

在实验中,我们通常会比较不同参数设置下的Glove模型性能,并与同样参数下的Word2Vec和FastText模型进行对比。结果表明,在某些情况下,Glove模型的确能够提供更高质量的词向量表示,尤其是在大规模语料库训练时。然而,在处理特定任务时,针对模型的优化和调整是至关重要的。

例如,在一个文本分类实验中,采用Glove模型作为文本向量化的基础,然后利用机器学习算法进行分类。实验结果可以使用混淆矩阵、准确率、精确率、召回率和F1分数等指标进行综合评价。在比较不同模型时,这些指标能够清晰地展示模型之间的性能差异,从而为选择合适的词向量模型提供数据支撑。

以下是实际实验中可能使用到的混淆矩阵和精确率的计算方式示例代码块:

from sklearn.metrics import confusion_matrix, classification_report

# 假设 y_true 和 y_pred 分别为真实标签和预测标签

y_true = [0, 1, 1, 0, 1, 0, 1]

y_pred = [0, 1, 0, 1, 1, 0, 0]

# 计算混淆矩阵

cm = confusion_matrix(y_true, y_pred)

print("Confusion Matrix:")

print(cm)

# 打印分类报告,显示精确率、召回率等指标

report = classification_report(y_true, y_pred, target_names=['Class0', 'Class1'])

print("\nClassification Report:")

print(report)

通过上述代码,我们可以清晰地看到模型在各个类别的分类性能,从而判断词向量的优劣。这样的实证分析对于选择最适合任务的模型至关重要。

5. 预训练Glove词向量的应用

预训练的Glove词向量已成为自然语言处理(NLP)领域的重要资源。通过大规模语料库的训练,Glove模型能够生成具有丰富语义信息的词向量,从而被广泛应用于各种NLP任务中。

5.1 预训练词向量的应用场景

5.1.1 词向量在自然语言处理中的角色

词向量作为NLP任务的基石,提供了一种将词汇转换为数值型向量的方法,这些向量捕捉了词义和词与词之间的关系。Glove词向量能够捕捉到词的多义性和上下文依赖性,使其在处理各种NLP问题时更具表现力和准确性。

5.1.2 预训练词向量的下游任务适应性

预训练词向量的适应性体现在它们可以直接用于下游任务,例如文本分类、命名实体识别、情感分析等,无需从头开始训练词向量。这大大减少了训练时间和计算资源的消耗,同时也能获得较好的性能。

5.2 预训练Glove的优化策略

5.2.1 微调与迁移学习的策略

在使用预训练词向量时,微调(Fine-tuning)和迁移学习(Transfer Learning)是两个常用的优化策略。微调意味着在特定任务的数据集上调整预训练词向量的参数,以更好地适应特定的下游任务。而迁移学习则是将预训练模型作为一个起点,利用其学习到的丰富语义信息,去训练新的模型解决特定问题。

5.2.2 提升下游任务性能的技巧

为了提升下游任务的性能,需要注意以下几点技巧:

- 任务适配 :了解下游任务的具体需求,选择或调整合适的预训练词向量。

- 数据增强 :通过数据增强技术(如回译、同义词替换等),增加模型对数据的泛化能力。

- 模型集成 :结合多个预训练模型,进行集成学习,以提高模型的鲁棒性和准确性。

代码示例:微调预训练Glove模型

import torch

from torch import nn

from torch.optim import Adam

from transformers import BertTokenizer, BertForSequenceClassification

# 加载预训练模型和分词器

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

model = BertForSequenceClassification.from_pretrained('bert-base-uncased')

# 准备数据集

texts = ["Text classification example", "Another example"]

labels = [1, 0] # 示例标签

# 将文本编码为模型能理解的格式

inputs = tokenizer(texts, padding=True, truncation=True, return_tensors='pt')

# 微调模型

optimizer = Adam(model.parameters(), lr=2e-5)

model.train()

for epoch in range(3): # 假设训练3个周期

optimizer.zero_grad()

outputs = model(**inputs)

loss = outputs.loss

loss.backward()

optimizer.step()

print(f"Epoch {epoch}, Loss: {loss.item()}")

# 评估或使用模型

# ...

预训练Glove词向量的应用是一个不断扩展的过程,随着技术的进步和更多高质量预训练词向量的出现,NLP领域的研究和应用将会更加深入和广泛。在实际应用中,选择和使用预训练词向量需要结合具体任务进行针对性的调整和优化,以达到最佳效果。

简介:在自然语言处理中,将单词转化为包含其语义和语法特性的低维度连续向量至关重要。Glove模型通过捕获词汇间的共现统计信息来实现这一点,提供全局信息处理,并在大型语料库上有优异表现。本文深入探讨Glove模型的原理与应用,阐述如何使用预训练模型和自训练模型,以及Glove如何在语义相似性和下游NLP任务性能提升中发挥作用。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)