一文读懂:到底什么是 “具身智能” ?

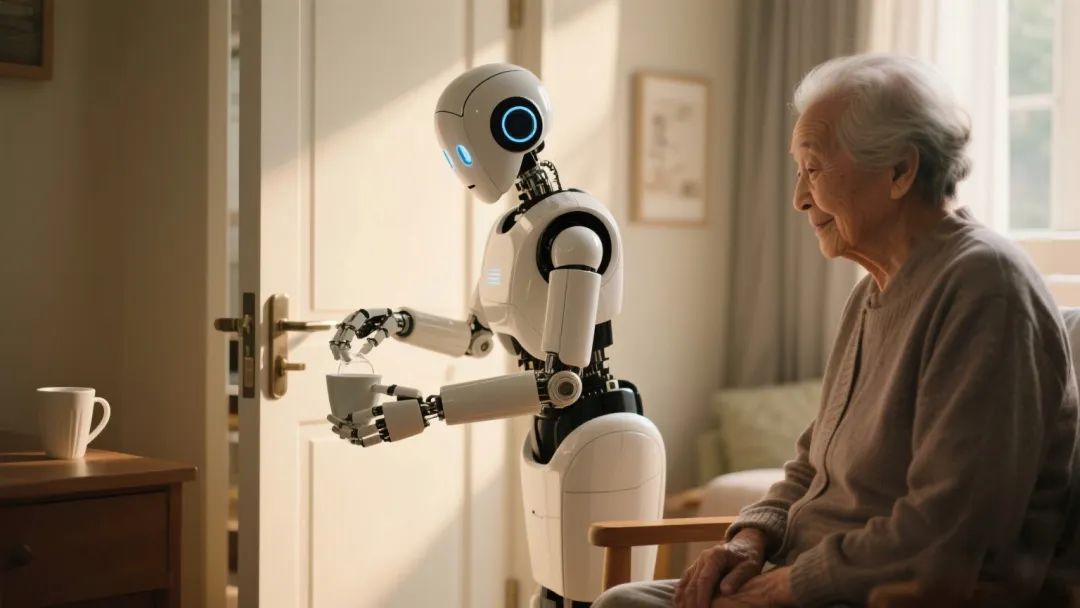

于是,具身智能的概念逐渐引起了更多人的关注。人形机器人的机械结构模仿人类的身体构造,具有类似关节、骨骼的部件,这样机器人就能做出更接近人类的动作,比如行走、奔跑、抓取等。比如,你对机器人说“请帮我拿一下桌子上的杯子”,机器人可以通过大语言模型理解这句话的意思,然后结合视觉感知算法找到杯子的位置,最后通过决策算法规划出一条路径,让机械臂去抓取杯子。现在的机器人大多只能在工厂那种结构化的环境里工作,要

各位小伙伴们,大家好!

今天咱们来好好聊聊一个最近很火的一个技术话题——具身智能!

这个词听起来是不是有点难懂?其实我们可以简单理解为:具身智能是具有身体的人工智能体。这样是不是会容易理解一些?

什么,还是不懂!

别急,接下来我用更通俗易懂的方式,给大家讲讲具身智能到底是个啥,它的发展史,它兜底能干些啥,以及它将如何改变我们的生活。

一、具身智能到底是个啥?

我们来看下具身智能的定义:

具身智能(Embodied Intelligence)是人工智能与机器人学交叉的前沿领域,强调智能体通过身体与环境的动态交互实现自主学习和进化,其核心在于将感知、行动与认知深度融合。

在传统的观念里,人工智能大多是“虚拟”的,比如手机里的语音助手、电脑上的智能客服,它们只能通过文字或语音和我们交流,但没办法直接和现实世界互动。

而具身智能则打破了这个限制,它通过传感器(相当于人类的眼睛、耳朵、皮肤等感觉器官)来感知周围的环境,比如光线、声音、温度、物体的位置等;然后通过执行器(比如机械臂、轮子、关节等)来做出相应的动作,比如抓取物体、行走、操作工具等。

这样一来,人工智能就不再局限于屏幕和云端,而是真正走进了我们的现实生活。

举个简单的例子,你可能见过扫地机器人吧?它其实就是一个初级的具身智能产品。它通过激光雷达和摄像头感知房间的布局和障碍物的位置,然后规划出清扫路径,最后通过轮子和吸尘装置完成清扫任务。这就是一个典型的“感知—决策—行动”的过程,也是具身智能的基本工作模式。

二、聊聊具身智能的发展史?

具身智能的发展其实经历了很长一段时间的探索和积累,它的历史可以分为几个阶段。

(一)概念萌芽期(1950—1990年)

早在1950年,计算机科学之父艾伦·图灵就提出了具身智能的概念。他设想,如果机器能够像人类一样拥有身体和感知能力,那么它们就能更好地理解世界并做出更智能的决策。不过,当时的技术条件还非常有限,计算机的性能很弱,传感器和执行器也很不成熟,所以具身智能只能停留在理论探讨的阶段。

在接下来的几十年里,科学家们一直在思考人工智能的本质。他们发现,传统的符号主义人工智能(即通过逻辑规则和符号推理来实现智能)在处理复杂现实问题时有很大的局限性。比如,让机器人按照预设程序去抓取一个物体,如果物体的位置稍微有点偏差,机器人可能就抓不到了。这说明,智能不仅需要逻辑推理,还需要通过身体与环境的互动来学习和适应。于是,具身智能的概念逐渐引起了更多人的关注。

(二)技术积累期(2000—2019年)

进入21世纪后,随着计算机技术的飞速发展,尤其是深度学习和强化学习技术的出现,人工智能开始在图像识别、语音识别、自然语言处理等领域取得了重大突破。这些技术为具身智能的发展奠定了基础。

在这个阶段,机器人在一些简单的任务上取得了一些进展。比如,通过深度学习算法,机器人能够识别出常见的物体形状和类别;通过强化学习,机器人可以在虚拟环境中不断尝试,学习如何更好地完成任务。不过,当时的机器人还远远称不上真正的智能,它们在复杂场景下的决策和行动能力还很有限,大多只能在实验室里进行一些简单的实验。

(三)快速发展期(2019年至今)

2019年以后,具身智能迎来了快速发展的阶段。这主要得益于大模型技术的出现。大模型拥有海量的参数,能够更好地理解和生成自然语言,这为机器人与人类的交互提供了更强大的支持。比如,现在的机器人可以通过语音指令理解人类的需求,然后做出相应的动作。

同时,硬件技术也取得了很大的进步。传感器的精度越来越高,成本也越来越低;执行器的性能也越来越好,能够实现更灵活、更精确的动作。比如,一些新型的触觉传感器可以模拟人类皮肤的触觉,让机器人在抓取物体时能够感知到物体的形状、质地和压力,从而更好地控制抓取力度。

此外,许多科技巨头也开始纷纷布局具身智能领域。比如,特斯拉推出了人形机器人Optimus,小米也发布了CyberDog等机器人产品。这些机器人在外观和功能上都越来越接近人类,能够完成一些复杂的动作,比如开门、拿东西、甚至跳舞等。这标志着具身智能从实验室走向了产业化,开始逐步进入我们的生活。

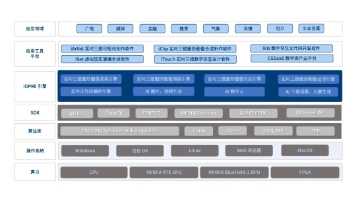

三、具身智能是怎么实现的?

具身智能的实现需要硬件和软件的完美配合,接下来咱们就详细聊聊这两方面。

(一)硬件基础方面

1. 传感器:机器人的“五官”

传感器是具身智能的“触角”,它让机器人能够感知周围的环境。摄像头就像是机器人的“眼睛”,能够捕捉到图像信息,帮助机器人识别物体的形状、颜色、位置等。比如,通过摄像头,机器人可以识别出这是杯子,那是椅子,还能判断物体的距离和方向。

激光雷达则是机器人的“探路器”,它通过发射激光束并测量反射光的时间来获取周围环境的三维空间信息。这样,机器人就能在复杂的环境中导航和避障,比如在房间里避开家具和障碍物,顺利地走到目标位置。

麦克风是机器人的“耳朵”,能够采集声音信号。这样,机器人就能听到人类的语音指令,还能识别环境中的声音,比如门铃声、电话声等。触觉传感器则模拟了人类的皮肤,让机器人在接触物体时能够感知压力、纹理等信息。比如,当机器人抓取一个易碎的杯子时,触觉传感器可以帮助它感知到杯子的形状和质地,从而调整抓取力度,避免把杯子捏碎。

2. 执行器:机器人的“肌肉”

执行器是机器人的“肌肉”,它负责将机器人的决策转化为实际行动。电机是最常见的执行器,它可以驱动机器人的关节运动,实现手臂的抬起、放下,腿部的行走、奔跑等动作。比如,机器人的机械臂可以通过电机的驱动,精准地抓取物体并将其移动到指定位置。

液压和气动执行器则在一些需要较大力量输出的机器人中应用。比如,在工业搬运机器人中,液压系统可以让机器人轻松地搬运重物。机械结构的设计也很重要,它决定了机器人动作的灵活性和协调性。人形机器人的机械结构模仿人类的身体构造,具有类似关节、骨骼的部件,这样机器人就能做出更接近人类的动作,比如行走、奔跑、抓取等。

3. 机械结构:机器人的“骨骼”

机械结构就像是机器人的“骨骼”,它决定了机器人动作的灵活性和协调性。人形机器人的机械结构模仿人类的身体构造,具有类似关节、骨骼的部件,这样机器人就能做出更接近人类的动作,比如行走、奔跑、抓取等。而工业机器人则根据不同的工作需求,设计出各种独特的机械臂结构,比如常见的多关节机械臂,它可以在狭小空间内完成精确操作。

(二)软件算法方面

1. 感知算法:让机器人“看懂”世界

感知算法是机器人的“大脑”,它对传感器采集到的数据进行处理和分析。以视觉感知为例,深度学习中的卷积神经网络(CNN)被广泛应用于图像识别,能让机器人从摄像头拍摄的图像中识别出各种物体。比如,机器人可以通过视觉感知算法识别出这是一个人,那是桌子,还能判断物体的颜色、形状和位置。

语义分割算法则能进一步将图像中的不同物体和背景进行区分,为机器人理解场景提供更详细的信息。比如,机器人可以通过语义分割算法识别出图像是在一个房间里,房间里有桌子、椅子、电视等物体,这样机器人就能更好地理解环境并做出相应的决策。在语音感知方面,基于循环神经网络(RNN)及其变体的语音识别算法,能够将麦克风采集到的声音信号转换为文本,便于机器人理解人类语言指令。

2. 决策算法:让机器人“思考”和“决策”

决策算法是机器人的“大脑”,它根据感知到的信息做出行动决策。强化学习算法在这里发挥重要作用,机器人在环境中不断尝试各种行动,根据获得的奖励或惩罚信号来调整自己的行为策略,逐渐找到最优的行动方式。比如,让机器人学习抓取不同形状的物体,通过不断尝试,根据抓取成功或失败的反馈,优化抓取的角度、力度等动作参数。

大语言模型也在决策中扮演重要角色,它可以根据自然语言指令,结合对环境的感知,为机器人规划一系列的行动步骤。比如,你对机器人说“请帮我拿一下桌子上的杯子”,机器人可以通过大语言模型理解这句话的意思,然后结合视觉感知算法找到杯子的位置,最后通过决策算法规划出一条路径,让机械臂去抓取杯子。

3. 控制算法:让机器人“行动”起来

控制算法是机器人的“神经系统”,它将决策转化为对执行器的精确控制信号。比如,通过控制电机的转速、扭矩等参数,实现机器人关节的精确运动控制,确保机器人能够准确地执行抓取、行走等动作。控制算法需要考虑机器人的动力学模型,确保动作的平稳性和准确性。

四、具身智能到底能干些啥?

具身智能的应用场景简直太多了,接下来咱们就详细聊聊它在各个领域的应用。

(一)家庭服务:机器人成为“全能管家”

具身智能机器人在家庭服务中的应用非常广泛。比如,升级版的扫地机器人不仅能自动清扫地面,还能通过机械臂推开拖鞋、捡起袜子,甚至能从冰箱里拿饮料。养老护理机器人可以搀扶老人起床、协助老人洗澡,还能监测老人的身体状况。儿童陪伴机器人可以和孩子聊天、讲故事、玩游戏,甚至还能辅导孩子学习。

(二)工业制造:机器人成为“超级工人”

在工业制造领域,具身智能机器人能够完成汽车零部件的精密装配、电子产品的精细制造等工作。它们可以通过视觉传感器精准识别零部件的形状和位置,利用机械臂快速、准确地完成装配任务,大大提高了生产效率和装配精度。

(三)医疗保健:机器人成为“超级医生”和“超级护士”

在医疗领域,具身智能机器人可以辅助医生进行手术,通过机械臂精准定位病变部位,提高手术的成功率和安全性。康复机器人可以辅助患者进行康复训练,根据患者的康复进度制定个性化的训练方案,帮助患者恢复身体功能。

(四)物流与仓储:机器人成为“超级搬运工”

在物流和仓储领域,具身智能机器人可以高效地完成货物的存储、搬运和分拣任务。它们可以通过视觉传感器识别货物的种类和数量,自主规划路径,避免碰撞,大大提高了物流效率。

(五)教育领域:机器人成为“超级老师”

在教育领域,具身智能机器人可以作为教师的教学助手,为学生提供个性化的学习体验。它们可以与学生互动交流,解答问题,通过游戏和活动帮助学生学习知识。对于有特殊教育需求的儿童,机器人还可以进行有针对性的互动,帮助他们提高社交能力和认知能力。

五、具身智能现在还有啥问题?

虽然具身智能听起来特别厉害,但它现在还处于“幼儿期”,还有很多问题需要解决呢。

(一)感知和行动还不太协调

比如,人类抓鸡蛋的时候,都知道要轻轻抓,但机器人可能就抓不准,要么把鸡蛋捏碎了,要么抓不起来。这是因为机器人的传感器还不够精准,而且它的动作控制还不够灵活。科学家们正在通过深度学习和物理仿真技术,让机器人在虚拟环境中“练习”抓取动作,然后再应用到现实中,以提高感知和行动的协调性。

(二)复杂环境里容易“懵”

现在的机器人大多只能在工厂那种结构化的环境里工作,要是到了家里这种杂乱的环境,比如桌子上堆满了东西,地上还有宠物玩具,机器人可能就“懵”了,不知道该怎么行动。不过,随着大模型技术的发展,机器人可以通过语言指令理解任务,并自主规划路径,逐步适应复杂环境。

(三)成本太高,普及难

像波士顿动力的机器人,虽然特别厉害,但价格也特别高,一台就要好几十万美元,普通家庭根本买不起。所以,科学家们也在努力降低成本,比如通过轻量化设计,用柔性材料做机器人,或者采用模块化组件,让机器人可以根据不同的任务更换不同的配件。

六、具身智能的未来会怎样?

说到未来,具身智能的发展前景可真是太让人期待了!

(一)未来五年:垂直领域大爆发

在未来五年内,具身智能会在一些特定的领域率先爆发。比如在仓储物流行业,分拣机器人可能会实现“看单—取货—打包”的全流程自动化,效率能提升好几倍。在农业领域,无人机和机械臂的组合可以识别成熟的果实并进行采摘,这不仅能提高效率,还能缓解劳动力短缺的问题。

(二)十年后:通用具身智能初现

再往后十年,具身智能可能会进入一个全新的阶段——通用具身智能。那时候,我们可能会看到“家庭机器人管家”,它们早上能叫你起床、给你做早餐,白天打扫卫生,晚上陪老人聊天,甚至还能帮你遛狗。而且,人机协作也会成为常态,比如在建筑工地上,机器人负责搬运重物、高空作业,人类则负责设计和质量检查。

(三)终极形态:人机共融的“智能体”

再往后,具身智能可能会和脑机接口结合,人类的意念可以直接控制机器人身体,实现“远程办公”。比如,宇航员可以在地球上操控火星上的机器人,进行各种复杂的任务。不过,这个阶段也面临着很多伦理挑战,比如机器人是否该拥有“自主决策权”,我们又该如何避免它们被滥用呢?

最后总结一下,具身智能和机器人技术的融合,将会让未来的机器人变得更加能干,甚至能理解和模拟简单的感情交互。而且,对具身智能和机器人的持续投入,更将带动从软件到硬件的整个产业链的发展。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)